Olá pessoal! Bom dia, Boa tarde, Boa noite! Mais um tema muito legal, espero que gostem!

A Inteligência Artificial (IA) é um campo muito em evidência hoje em dia, seja nos robôs de limpeza, vários tipos de softwares, etc. No entanto, a IA conta com uma ajuda de outra área da computação para apoiar seus algoritmos, que é a Redes Neurais Artificiais (RNA).

As Redes Neurais Artificiais são algoritmos computacionais criados a partir de observações dos neurônios biológicos, os pioneiros neste assunto são McCulloch e Pits (1943) que criaram o primeiro modelo matemático de um neurônio artificial chamado de neurônio MCP.

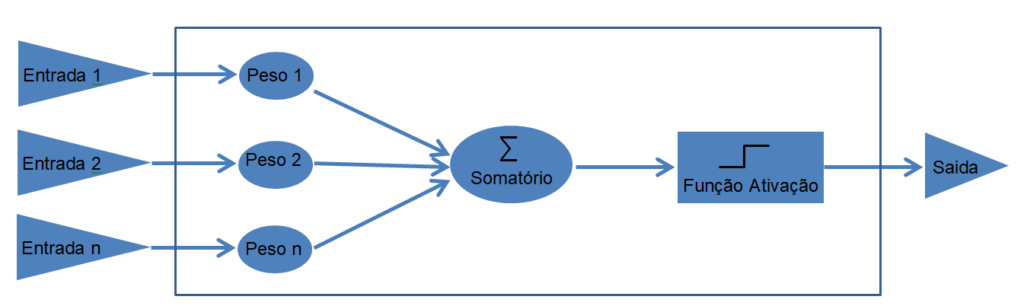

Este neurônio recebe várias entradas e para cada entrada é definido um peso, depois se faz um somatório de todas as entradas e o resultado é direcionado para a função de ativação, onde se o valor for menor do que o valor definido na função de ativação sua saída é 0 (zero) mas, se sua saida for igual ou maior sua saída será 1 (um).

Complicou? Não entendeu nada? Calma! Claro que não vou entrar nos detalhes do algoritmo, hehehe!

Hoje os algoritmos estão muito mais complexos do que este, obviamente.

Mas se o leitor quiser se aprofundar fique a vontade, há vários sites que falam os detalhes deste neurônio artificial. Outra dica inclusive, consulte as duas referências que deixei no final deste post.

O cérebro humano é utilizado constantemente por nós, muitas vezes sem percebermos, para reconhecer padrões nas coisas a nossa volta.

Por exemplo, quando você vê um banquinho, como você sabe que se trata de um banquinho e não de uma mesa?

Claro que nosso cérebro percebe rapidamente a diferença, pois já está treinado para reconhecer. Uma RNA também tem a capacidade de reconhecer padrões, esta na verdade é a sua principal característica.

Bom, creio que o conteúdo até agora é suficiente para que o leitor tenha uma pequena noção do que se trata as RNAs.

Como falamos na live, as RNAs são muito utilizadas hoje em dia no Deep Learning (Aprendizado profundo) e em Machine Learning (Aprendizado de máquina).

Vou tentar resumir ao máximo seus conceitos, tarefa difícil! heheh.

Primeiramente o Machine Learning.

Para contextualizar, vamos nos lembrar ou imaginar a época quando o e-mail foi popularizado. Naquele tempo o spam era muito pouco, mas um tempo depois, as caixas de e-mails ficaram “entupidas” de mensagens de propaganda que as pessoas sequer conheciam seus remetentes.

A quantidade era tanta de e-mails indesejados que tomava um bom tempo deletando essas mensagens!

Mas surgiu uma solução muito eficiente, o filtro antispam, onde um algoritmo de computador analisa e classifica as mensagens, direcionando o spam para a uma lixeira específica.

Portanto, Machine Learning são algoritmos ou sistemas que tem a capacidade de aprender e tomar decisões a partir de dados, com uma interferência mínima de um humano.

Outros exemplos são: detecção de fraudes em compras com cartão de crédito, anúncios, pesquisa na web, entre outros.

Agora, o Deep Learning utiliza RNAs interligadas com várias camadas intermediárias para conseguir reconhecer padrões complexos, como por exemplo: reconhecimento facial, identificação de fake news, reconhecimento de voz, etc.

Tradicionalmente uma RNA possui 2 a 3 camadas intermediárias, enquanto que uma de Deep Learning pode chegar a 150 camadas!

Agora, só para efeito de conhecimento, as RNA possuem basicamente dois tipos de aprendizado:

- Supervisionado: São algoritmo que necessitam de uma referência de dados válidos para classificação. Este tipo de algoritmo é normalmente utilizado quando se sabe o que se quer identificar. Por exemplo: reconhecimento de caracteres, imagem de um objeto específico, etc.

- Não Supervisionado: São algoritmos que não necessita de referências prévias ou quando essas mesmas não existem, a atualização de seus pesos são feitos de forma automática. Os resultados dos neurônios de saida são retornados aos de entrada, onde também são chamadas de Redes Recorrentes. Estes tipos de algoritmos procuram por padrões complexos de acordo com os dados de entrada atual e anteriores. Por exemplo: prever o preço de uma ação em uma bolsa de valores.

Espero que este artigo tenha esclarecido ao menos um pouco esta área muito interessante da computação. Há uma demanda crescente por profissionais nestas áreas então, se está na dúvida em qual área seguir, essa pode ser uma ótima opção de especialização.

Se quiser ver o vídeo na íntegra ele está ai logo abaixo. Falamos um pouco também sobre outros assuntos relacionados. Um abraço à todos e até a próxima!

Referências:

Bertozzo, R. J; 2019. Aplicação de machine learning em dataset de consultas médicas do SUS. Monografia. Universidade Federal de Santa Catarina. Florianópolis. Santa Catarina. Brasil. Acesse aqui.

Shizaki, M. Y; 2018. Reconhecimento automático de palavras. 2018. Monografia. Universidade Tecnológica Federal do Paraná. Cornélio Procópio. Paraná. Brasil. Acesse aqui.